把 ChatGPT 记忆迁移到 Claude:究竟哪些东西真的搬过去了

Claude 的记忆导入工具是真实存在的——但它只会迁移已保存的片段,而不是你的历史。这里准确说明哪些会迁移、哪些不会,以及如何填补这一缺口。

2026 年初,发生了某种转变。OpenAI 的 Pentagon 合作以及政策变化,促使数十万用户重新审视自己使用的 AI 平台。Claude 登上了 App Store 免费榜的第一名。Anthropic 报告自 1 月以来免费用户增长超过 60%——接着 Claude 在 24 小时内因其所称的"前所未有的需求"两次崩溃。

AI 平台切换第一次感觉像是一项主流决策,而不是技术极客的实验。也是第一次,切换时你会失去什么 这个问题变得紧迫到让一家主要 AI 公司下决心打造一个直接的答案。

3 月 2 日,Anthropic 推出了 claude.com/import-memory:把一段提示粘贴到 ChatGPT,复制它的输出,再导入到 Claude。五分钟。无需技术配置。你的 AI 记忆,就此迁移。

这是一次真正的进步。同时也值得清醒地看待:它究竟做了什么——以及到哪里为止。

官方工具如何运作

claude.com/import-memory 页面——Anthropic 的官方工具,把你的 AI 记忆从 ChatGPT、Gemini 或 Copilot 迁移到 Claude。(来源:Anthropic)

流程被有意设计得很简单:

- 前往 claude.com/import-memory,复制预先写好的导出提示

- 把它粘贴到一个新的 ChatGPT 对话中——ChatGPT 会返回一份你已保存偏好的结构化摘要

- 复制那段输出,粘贴到 Claude 的记忆导入框中

- 等待最多 24 小时,让 Claude 处理并应用这些上下文

无需浏览器扩展,无需账户关联,无需 API 凭据。Anthropic 同时将 Memory 对所有用户免费开放——此前它只对 Claude Pro 用户开放。隐私方面的定位也值得注意:与某些竞争对手不同,Claude 的记忆会被加密,并且不会用于模型训练。

可以较好地迁移的内容:

- 你给 AI 的语气与格式指令("简明扼要"、"使用要点列表")

- 你分享过的职业上下文:姓名、职位、行业、正在进行的项目

- 你明确讨论过的偏好和反复出现的话题

- "总是 / 从不"这类风格的指令

对于 AI 互动主要由明确偏好驱动的用户来说,这能在新平台上给你带来一个有意义的起步优势。

这个工具能捕获什么——以及它捕获不了什么

这部分是多数报道一笔带过的地方。

导入工具迁移的是 存储下来的记忆片段——那些 ChatGPT 明确决定要保存的事实和偏好。它并不会迁移在数月实际使用中积累起来的会话上下文:那些迭代式的打磨、AI 从观察你工作中学到的隐性模式、对你推理风格和领域词汇不断演化的理解。

你大多数有价值的 AI 上下文存在于对话历史里,而不是记忆设置页面里。导入工具并不会触及对话历史。

早期用户也反映了几个实际的摩擦点:

ChatGPT 可能只会导出很少的内容。 多位测试者反映,即便使用数月之后,这段提示从 ChatGPT 得到的输出依然很少。看起来 ChatGPT 对通过这一流程导出的内容有所限制——这个工具的效果完全取决于你的源 AI 明确保存了多少内容。

24 小时的处理延迟。 记忆更新按每日合成周期运行。你粘贴完上下文后,需要等一天它才会生效。

一次性快照,没有持续同步。 这是一个迁移工具,而不是一座桥梁。导入之后你在 ChatGPT 上继续构建的上下文,仍然停留在那里。你需要手动重复整个流程才能捕获之后的更新。

吸收程度不稳定。 Anthropic 将该功能标记为实验性,并指出"Claude 不一定总能成功吸收导入的记忆"。一些用户发现偏好并没有被可靠地体现在对话中。

以工作为重点的过滤。 Claude 的记忆系统围绕工作任务设计,可能会悄悄丢弃与职业上下文无关的个人细节。

核心缺口:存储快照 vs 持续上下文

真正的局限并不是导入工具里的某个 bug——而是结构性的。

AI 平台以阶段性快照的方式保存"记忆":模型认为值得记下的事实和偏好。但最有价值的 AI 上下文——那种真正使切换代价高昂的上下文——是 持续性的。它是在数月中数百次对话里浮现出来的理解:从未被明确陈述,却表现为 AI 仿佛真正懂你如何思考。

这种持续的上下文并不存在于记忆设置中。它存在于对话历史里。而对话历史会留在它被创造出来的那个平台上。

正如一份面向迁移用户的指南所说:"你的个性化并不只存在于保存下来的记忆中——它存在于你长期以来使用这个工具的方式里。"

对比:Claude 官方工具 vs Memdex

Memdex 作为共享的记忆层,位于你所有 AI 工具之上——不被锁定在任何单一平台中。(来源:Memdex)

Memdex 作为共享的记忆层,位于你所有 AI 工具之上——不被锁定在任何单一平台中。(来源:Memdex)

理解两者的差异,有助于你为自己的情况选对方案。

| Claude 官方导入 | Memdex | |

|---|---|---|

| 安装 | 无需安装 | 浏览器扩展(Chrome、Edge、Firefox) |

| 捕获内容 | 仅已保存的记忆片段 | 持续的会话上下文 |

| 更新频率 | 一次性快照 | 自动、持续进行 |

| 支持平台 | 仅 Claude | ChatGPT、Claude、Gemini 等 |

| 处理延迟 | 最多 24 小时 | 实时捕获 |

| 存储位置 | Claude 的服务器 | 你个人的 Memdex 账户 |

| 跨雇主可用 | 否——与你的 Claude 账户绑定 | 是——独立于任何平台账户 |

| 适用场景 | 有意地一次性切换到 Claude | 持续的跨平台记忆可移植性 |

在以下情况选择官方工具: 你正在进行一次有意的、永久性的 Claude 迁移,并希望用一种快速的方式把你的明确偏好带过去——且不想有任何安装摩擦。

在以下情况选择 Memdex: 你使用多个 AI 工具、计划在更好的模型出现时再次切换平台,或希望你累积下来的上下文始终可移植,无论你此刻在使用哪个 AI。

两者并不互斥。许多用户会先用官方导入,在 Claude 中立刻获得上下文,再用 Memdex 确保从那一刻起,他们的记忆能够持续增长、保持可移植。

Memdex 在后台持续捕获来自每一个 AI 平台的上下文——无需手动导出。(来源:Memdex)

Memdex 在后台持续捕获来自每一个 AI 平台的上下文——无需手动导出。(来源:Memdex)

你的记忆应当比每一代模型都活得更长

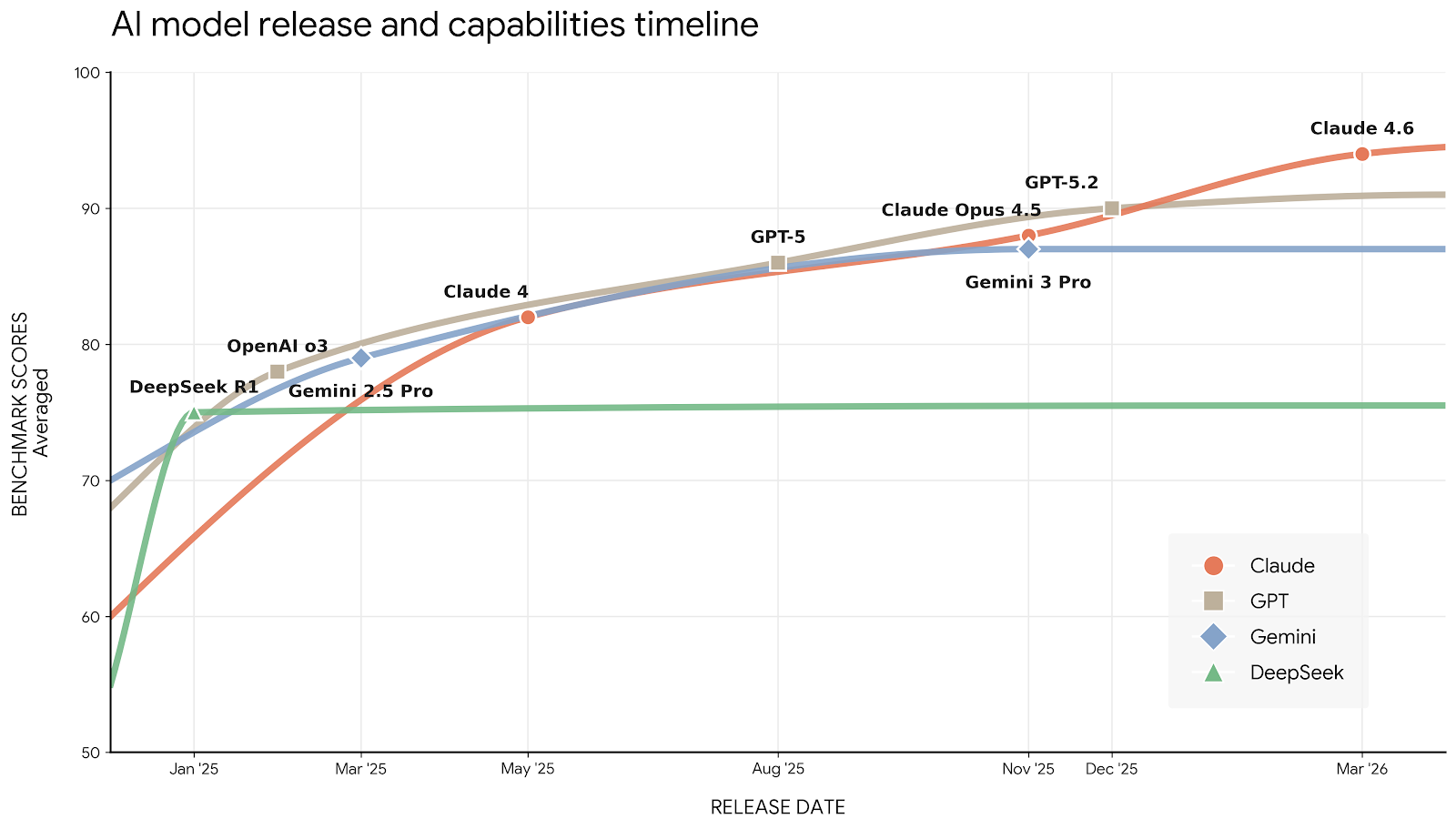

前沿 AI 能力从 2025 年初到 2026 年初翻了一倍有余,新的 SOTA 模型每隔几周就会出现一次。

前沿 AI 能力从 2025 年初到 2026 年初翻了一倍有余,新的 SOTA 模型每隔几周就会出现一次。

看看这一轨迹。GPT-3.5 到 GPT-4。GPT-4 到 o1。o1 到 GPT-5。Claude 3 到 Claude 4 到 Claude 4.6。每一代都带来有意义的显著改进——而且节奏并未放缓。GPT-6、Claude 5、Gemini 4 已经在构建之中。对你工作真正有意义的下一个模型,大概距离现在 3 到 6 个月。

如果你的记忆存在于单一平台的账户中,这意味着什么:每一次新模型发布都会迫使你缴税。 要么留在旧模型上(安全,但会落后),要么迁移到新模型上(更好,但再次付出重新上手的成本)。你累积的上下文越有价值,这个选择就越痛苦。

解决办法是把你的记忆存储在根本不在任何模型账户里的地方——在你这一侧的对话之中。

当 Memdex 捕获你的 AI 上下文时,它会把内容存储在你个人账户里,存放于你的设备和我们的服务器上。它不在 OpenAI 的基础设施里,不在 Anthropic 的,也不在 Google 的。当 GPT-6 发布、你想去试试它的时候,你完整的上下文早已在那里等着你。不需要导入提示,不需要 24 小时延迟,也不用担心导出被阻断。你只要打开那个新模型,从你上次停下的地方继续即可。

Claude 在 3 月 2 日至 3 日的宕机——由大规模迁移引发——说明了这个问题的另一面:平台依赖是真实存在的。当 Claude 宕机时,数千人在迁移中途工作被迫停止。把你的记忆存储在任何单一平台之外,意味着一次宕机只会变成一种不便,而不是一次数据损失事件。

常见问题

免费 Claude 用户也能使用这次导入吗? 可以。Anthropic 在 2026 年 3 月推出导入工具时,同时把 Memory 开放给了所有 Claude 用户。

导入的记忆会保持最新吗? 不会。导入是一次性的快照。导入日期之后你在 ChatGPT 上构建的新上下文不会自动出现在 Claude 中。

这个流程对 Gemini 或 Copilot 也适用吗? 适用——同样的流程可以用于任何具有记忆功能的 AI。那段导出提示被设计成可以粘贴到任意助手中,尽管不同平台的效果会有差别。

如果我想撤销导入怎么办? 前往 Claude 设置 → Memory,逐条删除已导入的条目即可。

核心结论

官方工具解决了一个真实的问题:切换平台时从零开始的摩擦。对于有意地一次性迁移到 Claude 来说,相较于手工复制粘贴上下文,它是一次有意义的改进。

它没有解决的,是更深层的结构性问题:你的 AI 记忆被绑定在它最初构建时所在的那个平台账户上,而当模型不断进步、情况不断变化时,它并没有持续的可移植性。

对每天都要与 AI 打交道的职业人士来说,一个可移植的记忆层——持续捕获上下文、存储在你自己的账户里,并跨平台和跨雇主随你而走——才是更经得起时间考验的答案。

Memdex——持续的 AI 记忆捕获,存储在你的账户中,在任意平台可用。面向 Chrome、Edge 和 Firefox 的浏览器扩展。